Голос разума. Повесть о революции в технологиях распознавания речи: от «Кинекта» до искусственного интеллекта

Голосовое управление занимает странное место в нашей жизни. С одной стороны, это привычная всем технология, которая давно не вызывает особого удивления, с другой… если изучить вопрос более внимательно, удивительным становится именно наше равнодушие, ведь не далее как год-два назад в этой сфере началась глобальная революция, которая может затронуть не только вопросы распознавания речи, но и смежные направления науки, вплоть до искусственного интеллекта.

Поэтому мы решили провести собственное расследование, в котором подробно изучили историю вопроса, разобрались, что умеют компьютеры сегодня и чего стоит ждать от них завтра.

И, конечно же, мы поговорим об играх. Пусть до недавнего времени разработчики не баловали нас возможностью размять в игре голосовые связки, но происходящие перемены затронули и игровую индустрию, которая, кроме шуток, стоит на пороге больших перемен.

По дороге богов

Человек начал мечтать о разумных машинах очень давно. Возможно, причина тому — религии с их схожими историями о сотворении человечества разными высшими существами. Так уж устроены люди: самый большой орган в нашем организме — это Эго. Создать разум значило совершить акт божественного творения, уподобить себя богам.

Еще в XVIII веке газетные заголовки пестрели сообщениями о демонстрировавшихся на выставках технологических новинок железных людях, названных неведомым доселе словом «андроиды». Они вели себя подобно человеку, играли на музыкальных инструментах и даже разговаривали. Конечно, это были лишь хитроумные механизмы, но людям в те времена это казалось настоящим чудом.

[[BULLET]] На съемочной площадке фильма «Метрополис».

Вера в могущество науки была безгранична. Казалось, что вот-вот в нашу жизнь войдут разумные машины, мыслящие и понимающие наш язык. О таких машинах писали многие фантасты. Так, например, отец российской фантастики Александр Беляев посвятил этой теме юмористический рассказ «Сезам, откройся!!!», а немой фильм «Метрополис» 1927 года стал настоящим прародителем современного «Терминатора» — там даже есть эпизод, когда притворяющийся живым человеком робот сгорает в пламени, обнажая металлический остов.

Но время шло, а мечта не только не приближалась, но становилась все более и более далекой. Появились компьютеры, способные выполнять миллиарды операций в секунду, но чем больше развивалась наука и техника — тем яснее люди понимали, насколько сложно будет придать машине элементы человечности.

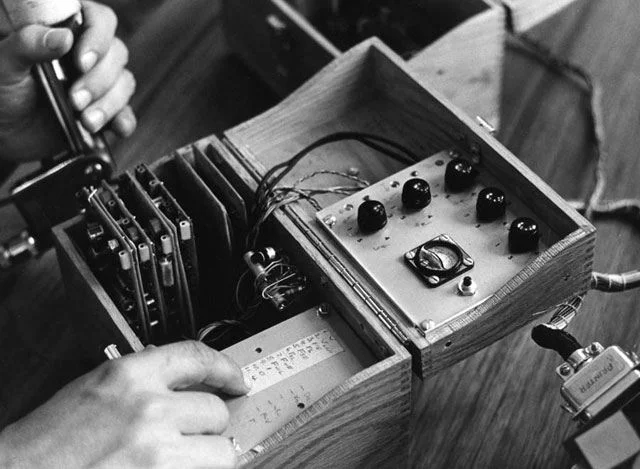

[[BULLET]] Компьютер IBM Shoebox, представленный на знаменитой выставке «Экспо XXI века» в Сиэтле, был, по сути, калькулятором с голосовым вводом и понимал предложения типа «два плюс два равно».

Пришлось отложить мечты об искусственном интеллекте и разумных человекоподобных роботах в долгий ящик и приняться за более простые задачи. И первым делом люди решили научить компьютеры понимать человеческую речь. Потому что речь всегда ассоциировалась у человека с разумом. Есть даже такой синоним к слову «животное» — «тварь бессловесная», то есть неразумное существо, которое ничего не понимает, а значит, с него и спроса нет. С компьютеров же спрос всегда был очень высок, так что учить их словесным премудростям начали с самых пеленок.

Прогнозы - дело тонкое

В 1987 году Билл Гейтс предсказал, что в борьбе операционных систем победу одержит OS/2 от IBM. В 1989-м он категорично заявил, что Microsoft никогда не выпустит 32-битную операционную систему. В 2004-м Гейтс уверял нас, что через пару лет о спаме можно будет забыть навсегда.

Оказывается, что основатель Microsoft отметился также пророчеством по поводу голосового управления, заявив, что через десять лет клавиатуры станут не нужны, так как компьютеры будущего смогут понимать человеческую речь.

Произошло это в далеком 1997 году. Прошло десять лет, но его предсказание так и не сбылось. В 2008-м он его подкорректировал, сказав, что через пять лет большая часть интернет-запросов будет совершаться с помощью речи, а не клавиатуры. Прошло еще пять лет, и очередное пророчество Гейтса снова попало в молоко. Даже пользователи планшетов и мобильных чаще пользуются текстовым поиском, не говоря уж об остальных.

Что поделать, не везет Гейтсу на предсказания… Недаром он отметился в списке десяти худших нострадамусов технического прогресса - наряду с Кеном Олсеном, который считал, что домашние компьютеры никому не нужны, и Алексом Левитом, который в 1955 году предрек скорое появление пылесоса с ядерным реактором.

Первые шаги

Первый компьютер, с которым можно было поговорить, появился более полусотни лет назад: в 1952 году исследовательский центр Bell Labs представил устройство Audrey , которое могло распознавать цифры, произнесенные одним конкретным человеком. Правда, на этом дело застопорилось. На то, чтобы научить компьютер распознавать 16 английских слов, ушло еще 10 лет, а в 1969-м инженер Джон Пирс из все той же Bell Labs и вовсе заявил, что научить компьютеры понимать людей не получится еще как минимум несколько десятков лет, так как для этого потребуется изобретение искусственного интеллекта.

Однако уже в следующем году произошел, вероятно, самый существенный прорыв в теории распознавания речи. Математик Леонард Баум из Принстонского университета создал статистический метод, названный «скрытая марковская модель». Стало ясно, что компьютеры могут понимать человека без всяких искусственных интеллектов, на базе одной лишь статистики. Правда, до применения теории на практике было еще далеко.

[[BULLET]] Привыкли к тому, что компьютер понимает вас на лету? Мейнфрейм IBM 370 (1970 год), занимавший целую комнату, тратил на обработку одной лишь фразы около часа.

В 1971 году к исследованиям подключились военные. Агентство передовых оборонных исследований (одно из подразделений Министерства обороны США, отвечающее за перспективные военные технологии) вложило 15 миллионов в разработку компьютера, который должен был преобразовывать в текст человеческую речь. В течение пяти лет несколько лабораторий усиленно тратили деньги налогоплательщиков, создав две системы, названные Harpy и Hearsay. Хотя для того времени это были уникальные машины, нельзя сказать, что они выполнили поставленную цель, так как имели словарный запас трехлетнего ребенка (около тысячи слов) и постоянно ошибались.

Стало ясно, что одними лишь мозгами и деньгами проблему не решить. Нужно было ждать появления более мощных компьютеров. Лишь в 1985 году гениальному американскому инженеру Рею Курцвейлю удалось создать первую коммерческую систему распознавания речи — Kurzweil Voice System , — которая понимала все ту же тысячу слов да при этом требовала от говорящего делать паузы между словами.

Особого успеха она не имела, так как стоила очень дорого и, по сути, была лишь высокотехнологичной игрушкой. Но выход Kurzweil Voice System показал, что компьютеры наконец-то доросли до нужного уровня. В 1987-м вышла новая версия системы, которая понимала более 20 тысяч слов.

В этом же году технологии распознавания речи впервые отметились в развлечениях: была выпущена говорящая кукла Джулия, которая, несмотря на гламурный вид, была весьма серьезным роботом-андроидом. Задавая ребенку вопросы (типа «скажи такое-то слово»), она подстраивалась под его голос, чтобы уменьшить количество ошибок. Плюс к этому кукла строила беседу так, чтобы ребенку нужно было давать лишь простые ответы: «да», «нет», «хорошо».

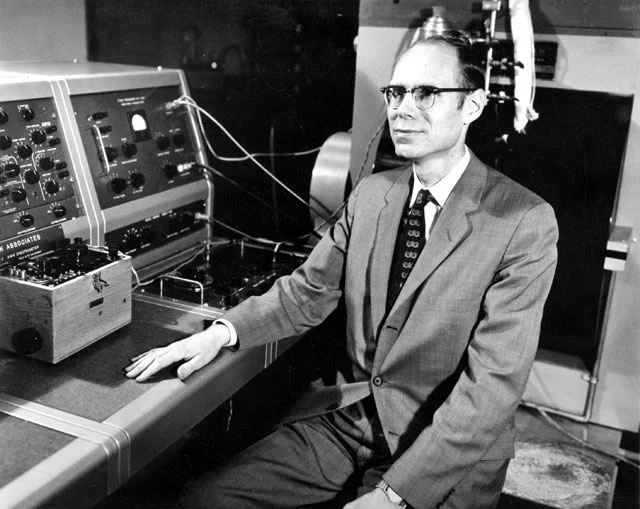

[[BULLET]] В 1969 году Джон Пирс сказал, что работы по распознаванию речи похожи на поиски лекарства от рака, полеты на Луну или превращение воды в бензин. В том смысле, что для получения денег надо найти дураков, которых можно обмануть и «пустить пыль в глаза». Уровень цинизма этого суждения можно оценить по тому факту, что к тому времени полет на Луну уже состоялся.

Чтобы создать первые программы по распознаванию непрерывной речи, ушло еще лет десять. Они были очень неуклюжими, часто ошибались, имели жесткие требования к синтаксису предложений и в целом были очень неудобны в использовании. Но они работали. И, что важнее, это уже были не аппараты ценой в тысячу долларов, со специальными микросхемами и собственными микрофонами. Это были относительно дешевые программы, работавшие на любом компьютере.

К концу 1990-х такие программы пошли в массы. Они конкурировали друг с другом, становясь все более дешевыми, удобными и эффективными. Именно этот момент можно считать началом современной эпохи распознавания речи — эпохи, когда технологии выбрались из застенков лабораторий и выставочных стендов и зашагали навстречу обычным пользователям.

Как это работает

Изобретение скрытой марковской модели стало важной вехой в истории развития систем распознавания речи. До этого компьютеры умели лишь сравнивать произнесенные слова с заложенными в память образцами. Такая схема хорошо работала с ограниченным набором слов, произнесенных одним человеком, но на большее была неспособна.

Однако в реальной жизни требуется распознавать разные голоса, разные акценты, невнятную речь, отличать друг от друга похожие слова, фильтровать посторонний шум. Все это невероятно усложняет задачу. Даже человеческое ухо обычно не распознает многие части произнесенных слов, воссоздавая их смысл по ключевым звукам, по смыслу соседних слов, теме разговора и другими способами, о которых мы с вами даже не задумываемся.

[[BULLET]] Примерно так выглядит нейронная сеть Google — бесконечные ряды серверных стоек.

Хотите узнать, что вы слышите на самом деле — просто прислушайтесь к разговору на незнакомом языке. Например, найдите на YouTube ролик на китайском или арабском. Не понимая смысла слов, вы просто не сможете понять, как они звучат. Если вы попробуете записать или повторить предложение, наверняка получится отборная белиберда. Да что там предложение — во многих случаях вы даже не поймете, где кончается одно слово и начинается другое.

Чтобы понять глубину проблемы, начнем с самого начала. Рядовой российский ребенок учит 33 буквы — задача относительно легкая. В речи буквы произносятся с помощью звуков, или, выражаясь по-научному, фонем. Но вот беда, человек не привык говорить слова по буквам или звукам. Он говорит их быстро и непрерывно, фонемы перетекают одна в другую, приобретая массу нюансов в произношении, в зависимости от своего местонахождения. Мы этого не замечаем, но один лишь звук [а] в русском языке имеет четыре разных варианта звучания!

Все эти варианты называются «аллофонами». И если фонем, как и букв, несколько десятков, то численность аллофонов достигает нескольких сотен. Чтобы понять, какой именно аллофон прозвучал, компьютер обычно исследует не только его самого, но и пару соседних звуков — ведь именно от них зависит звучание распознаваемого аллофона. Эти три звука называются «трифоном».

[[BULLET]] Кукла Джулия не только понимала слова. Она могла сказать, что ей холодно или жарко, чувствовала, когда ее поднимают, и могла различать свет и темноту.

По сути, трифон является для компьютера тем же самым, что и буква для человека. Для того чтобы обучить компьютер русскому языку, надо проанализировать с десяток тысяч часов аудиозаписей (а лучше сотню тысяч), вычленив как минимум несколько тысяч трифонов. Такой вот «алфавит» приходится учить компьютеру для понимания человеческой речи.

Несмотря на все эти ухищрения, избежать ошибок не удается. На каждое слово получается множество вариантов, что бы оно могло означать. Лук сварился? Пук спалился? Бук свалился? Сук спилился? Бука спился? Вот тут-то как раз и приходят на выручку скрытые марковские модели, которые с помощью статистики позволяют определить наиболее вероятное значение каждого аллофона или даже целого слова, спрогнозировать грамматическую структуру предложения, отсечь все заведомо невозможные варианты.

В современных программах также используется весьма ресурсоемкая система сопоставления семантического значения слов. Также как и мозг человека, компьютер сопоставляет слово с соседними. Если есть выбор между словами «железо» и «береза», а рядом стоит слово «ржавое», то, скорее всего, речь идет все-таки о железе.

Но и этого недостаточно для получения удовлетворительного результата. Попытка взять проблему в лоб, разложить речь по полочкам и досконально ее проанализировать, позорно провалилась. Даже самые совершенные аналитические методы выдают около 20% ошибок, в то время как человек допускает погрешность в 2-4%.

[[BULLET]] А так выглядит «кровеносная система» нейронной сети. Мощные охлаждающие установки создают серверам комфортный микроклимат.

Вторая проблема заключается в том, что такие системы распознавания речи неспособны обучаться. Есть программы, способные приспосабливаться к голосу конкретного человека, но это совсем не то, что нужно. В начале XXI века в этой сфере наступил кризис, развитие технологий практически прекратилось. Программисты зашли в тупик, а некоторые ученые до того разуверились во всемогуществе компьютеров, что были готовы признать окончательное поражение: мол, прав был старина Пирс, без искусственного интеллекта нормально проблему действительно не решить.

Чтобы выйти из тупика, потребовалось еще десять лет. В 2010 году Google создала сервис голосового поиска, избавив владельцев планшетов и мобильников от необходимости вводить запрос с помощью неудобной экранной клавиатуры. Так как сервису приходилось иметь дело не с предложениями, а с короткими фразами, многие описанные выше методы оказались малоэффективными. Потому инженеры компании решили подойти к решению проблемы с другой стороны, создав сложнейшую систему анализа человеческой речи на основе искусственной нейронной сети.

Китайская комната

Хотя вся наша статья посвящена проблеме распознавания голоса, многие могут задаться вопросом: а может ли компьютер действительно понять и осознать сказанное человеком? Понятное дело, что для этого потребуется создать искусственный интеллект. Но возможно ли это в принципе? Этот вопрос давно занимает ученых всего мира.

В 1980 году американский философ-лингвист Джон Сёрль заявил, что такого не будет никогда. В доказательство он привел концепцию «китайской комнаты»: представьте себе, что вы сидите в комнате с двумя окошками. У вас есть ящик с китайскими иероглифами и инструкция. В инструкции описаны все варианты иероглифов, которые могут поступить в первое окошко. В ответ вам надо будет отправлять во второе окошко другой набор иероглифов - тоже согласно инструкции.

Сидя целый день в комнате, вы получаете и отправляете иероглифы, совершенно не понимая их смысла. Вам может поступить вопрос «Какие ваши любимые цветы?» - вы сверитесь с инструкцией и отправите набор иероглифов, значащий «Мне нравятся ромашки». Но вы этого никогда не узнаете! У вас просто нет возможности понять, что значит хотя бы один иероглиф.

Однако же для того, кто отправляет вам вопросы и получает ответы, может сложиться впечатление, что вы знаете китайский язык, хотя вы лишь действуете по инструкции.

В этом примере человек представляет собой компьютер, ящик с иероглифами - базу данных, инструкция - программу, а два окошка - каналы ввода и вывода информации. По идее Джона, компьютер и человек никогда не смогут говорить на одном языке, так как разделены стенами «китайской комнаты».

Впрочем, многие ученые заявляют, что аналогия с «китайской комнатой» ошибочна. Да, человек в китайской комнате не знает китайского. Но сама китайская комната - с человеком, инструкцией и прочим - может считаться знатоком китайского языка. Плюс к этому нейроны в мозге человека, если подходить к ним с точки зрения физиологии, тоже бездумно выполняют механическую работу в виде «сортировки иероглифов по инструкции», что не мешает нам иметь сознание.

Так что не факт, что одинаковое сознание не может существовать на разной элементной базе. Какая разница, чем думать - белковыми реакциями или электронами? В какой-то степени мы с компьютерами даже похожи, нейроны ведь тоже генерируют электрические импульсы, и никто достоверно еще не отрицал, что механизм памяти не завязан именно на этом процессе. Точнее, он точно завязан и на этом процессе тоже. Вот только как именно - точно никто так пока и не разобрался.

Нейронные сети

Мы уже дважды упоминали предсказание Джона Пирса о том, что для распознавания человеческой речи потребуется несколько десятков лет и создание искусственного интеллекта. Так вот, это предсказание почти сбылось: прошло уже почти 45 лет, а более-менее удовлетворительные результаты были получены лишь недавно, когда Google начала применять для системы голосового поиска систему искусственных нейронных сетей (ИНС), построенных на принципах, схожих с принципами работы человеческого мозга.

[[BULLET]] Во времена пиара Kinect Питер Молиньё показывал виртуального мальчика Майло, который мог свободно понимать человеческую речь. Правда, посторонним с ним говорить не разрешалось, а потом проект и вовсе закрыли. Вот теперь все гадают, а был ли мальчик?

Ключевая особенность ИНС — способность к обучению, а также обобщению и сопоставлению получаемой информации. Как и в человеческом мозге, информация обрабатывается на нескольких уровнях: данные поступают на входной слой нейронов, модифицируются, затем поступают на следующий слой нейронов, снова обрабатываются и так далее.

Но если в обычном компьютере прохождение информации никак не влияет на его структуру, то в нейронной сети — настоящей или искусственной — обработка информации порождает новые ассоциативные связи между нейронами, перестраивая весь механизм обработки этой информации. Нейронная сеть учится, меняется и приспосабливается под те данные, с которыми ей приходится работать.

Нельзя сказать, что ИНС — современное изобретение. Первый нейрокомпьютер, «Марк 1», был создан в 1958 году, а теоретические исследования в этой области велись еще раньше. Кстати, «Марк 1» первым делом попытались приспособить для фонетического анализа речи, научив его распознавать несколько английских букв, но практического толка от этого было мало. Мощность процессоров того времени была слишком низкой для решения столь сложных задач. Интерес общественности к нейронным сетям то спадал, то снова возрождался. Довольно бурно перспективы ИНС обсуждали в 1980-х, но затем все снова надолго заглохло, вплоть до недавнего времени.

В прошлом году Google объявила о том, что их секретная лаборатория создала ИНС, которая будет использована для улучшения качества работы онлайновых сервисов — повышения точности распознавания речи и изображений, а также улучшения качества машинного перевода на Google-переводчике. Шестнадцать тысяч процессоров были объединены в нейронную сеть с миллиардом взаимодействующих «нейронов», каждый из которых являлся отдельным программным процессом.

[[BULLET]] Ох уж эти японцы. Вот с такой вот штукой приходилось разговаривать детям, желавшим поиграть в Seaman.

Миллиард. Это много или мало? Для сравнения, в мозге человека находится в среднем 86 миллиардов нейронов, причем еще не факт, что все они работают, — некоторые исследователи не устают твердить, что мы задействуем лишь 10% своих умственных способностей. У бабуина так вообще 14 миллиардов, а сколько их у таракана? Конечно, интеллект не зависит напрямую от количества нейронов, а не то самым умным был бы какой-нибудь слон или кашалот (почти 7 килограммов мозгов, внушает, да?), но сам факт, что искусственные нейронные сети по сложности догнали биологические виды, просто поражает.

Инженеры лаборатории заставляли нейронную сеть «смотреть» тысячи роликов на YouTube, находя на них милых пушистых котиков: в отличие от обычных компьютеров, которым требовалось бы показать сперва кучу этих самых котиков, ИНС на основе начальных данных самостоятельно пыталась рассортировать ролики с кошками и без них, а когда ей указывали на ошибку, сама уточняла алгоритмы распознавания. В итоге кибермозг таки понял, что такое котики, и начал уверено выбирать видео с их участием.

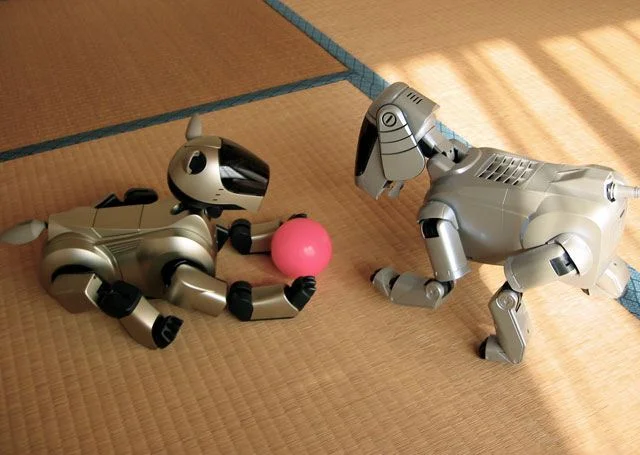

[[BULLET]] Робот Aibo умел понимать множество команд, однако из-за своей бесполезности популярности не снискал. Люди оказались на редкость циничны и предпочли милой собачке Aibo более практичные роботы-пылесосы.

Однако самые лучшие результаты самообучающаяся ИНС показала в деле распознавания речи, разом уменьшив число ошибок на 25%. Сегодня, когда вы пользуетесь голосовым поиском, смартфон строит спектрограмму вашей фразы, которая передается на анализ сразу восьми серверам. После этого данные проходят ту же многоуровневую обработку, что и в нейронной сети, — используя самообучающиеся математические модели, система анализирует аллофоны, составляет из них слова, из слов формирует фразы и предложения. Анализируя огромную базу спектрограмм, ИНС учится выделять ключевые моменты, игнорируя при этом локальные особенности говорящего, такие как акцент, шумы и прочее.

Kinect: борьба за чистоту звука

Нейронные сети — уж простите нам этот жаргонизм — это круто. Правда, на практике путь таким технологиям порой преграждают совершенно банальные проблемы, которые были успешно разрешены еще полвека назад. Взять, скажем, микрофон. Изобрели его давно, и может показаться, что улучшать уже нечего. Тем не менее проблема качественной записи речи все равно остается актуальной.

Например, голосовой поиск от Google в зависимости от устройства может вести себя совершенно по-разному: на дорогом смартфоне с качественным микрофоном он работает безупречно, а на дешевом планшете начинает выдавать совершеннейшую чушь, предлагая на простую фразу «блюда с рисом» варианты вроде «дети слизи». Мы решили подробно изучить современные технологии записи голоса, взяв в качестве примера известный всем контроллер движения Kinect.

[[BULLET]] В Lifeline разработчики, конечно, переборщили с голосовым управлением. Однако для игр типа BioShock Infinite возможность поболтать с игровым персонажем была бы очень кстати.

Когда Microsoft выпустила Kinect, главный упор делался на функции распознавания движений. Однако аркады обычным игрокам были не интересны, а в серьезных тайтлах он прижился только в роли микрофона, став основой для голосового управления в ряде весьма популярных игр. Причем эта возможность была эксклюзивной, что немало раздражало тех, кто не собирался приобретать Kinect ради возможности покричать диким голосом в монитор «ФУС РО ДА!!!»

Возмущенные игроки задавались вопросом — как такая простая фишка может быть эксклюзивной? Микрофоны есть везде! Есть куча игр с голосовыми командами! Разработчики продались Microsoft!

Рискнем предположить, что все гораздо проще. Kinect — это не только пластиковая штука с тремя глазами, но еще и качественный софт для разработчиков, который позволяет добавить в игру голосовые команды практически бесплатно. Достаточно лишь прописать список фраз, а приставка с Kinect сама будет слушать игрока, передавая в игру сигналы о произнесенных им командах. Если можно на халяву реализовать интересную фишку, то почему бы и нет?

Однако нас в первую очередь интересует технология записи. Многие игроки на собственной практике не раз убеждались, что для нормальной записи голоса на одиночный микрофон нужно расположить его в паре сантиметров от говорящего. Направленные микрофоны могут увеличить дистанцию, но их нужно нацеливать на источник звука. Система с подвижным микрофоном вышла бы слишком сложной (не может же приставка, подобно заправскому журналисту, тыкать рукой с микрофоном в направлении игрока). Поэтому в Kinect использовали старое и проверенное решение в виде массива из четырех микрофонов.

[[BULLET]] С пылесосом теперь тоже можно поговорить. Вот пылесос Sharp Cocorobo — если говорить с ним каждый день, у него будет хорошее настроение, он будет бодр и весел. Вы это почувствуете по его голосу и поведению.

Микрофонные массивы как нельзя лучше подходят для решения задачи подавления шумов и повышения качества записи голоса. Однако в случае с Kinect задачка получилась куда сложнее обычного. Ревущие динамики — это вам не просто шум. Игроки любят во время игры делать звук погромче, плюс колонки обычно находятся гораздо ближе к контроллеру, чем игрок. Да еще стоит учесть, что на контроллере нет кнопки включения микрофона, который мог бы предупредить систему, когда именно будет произнесена команда. Микрофон включен всегда, так что слушать приходится постоянно.

Проблему с нейтрализацией звука от динамиков вообще-то решили давно — система эхоподавления есть в любом телефоне с громкой связью. Если система знает, что именно сейчас звучит в колонках (а она знает, ведь она сама туда сигнал посылает), то она может просто «вычесть» этот сигнал, оставив вместо него почти полную тишину. Однако такой подход хорошо работает только с монозвуком умеренной мощности. Kinect же использовал первый в мире алгоритм стереоакустического эхоподавления, который, по словам разработчиков, дался им ценой немалых усилий.

Ну а массив микрофонов позволял окончательно очистить сигнал от шумов и паразитных ревербераций путем точного определения источника звука. Зная, где сидит пользователь, Kinect старательно глушит все звуки, идущие из других мест. Как видите, железо все-таки играет немаловажное значение в деле распознавания речи.

Хотя программы все-таки важнее. Например, на видеокамере PS EYE есть точно такой же массив из четырех микрофонов, а в Skyrim нашу любимую «фусроду» покричать не во что.

И у стен есть уши

В повседневной жизни распознавание голоса используется пока не очень широко, но, как и везде, ситуация меняется. В Корее начали проводить интересный эксперимент: несколько десятков школ заменили живых учителей английского языка на роботов Engkey.

Робот дает детям задания, выслушивает ответы, исправляет ошибки в произношении. Если же без живого человека не обойтись, можно включить встроенный экран и побеседовать с реальным учителем, где бы он ни находился. Такие роботы могут решить проблему нехватки учителей в сельской местности. Кроме того, школы отмечают, что применение Engkey позволило повысить успеваемость (хотя мы тут, в редакции, с ходу придумали кучу способов, как такого робота можно обмануть, так что статистика - дело такое).

Американские (да и не только американские) компании все чаще сажают за телефон службы техподдержки не живых людей, а компьютеры, которые могут как минимум зарегистрировать обращение и записать данные человека, а порой и дать совет по возникшей проблеме. В отличие от человека, компьютер обходится много дешевле, обладает воистину железными нервами и может круглосуточно отвечать на глупые вопросы. Правда, пользователи жалуются, что качество распознавания голоса очень низкое, компьютеры тупые и не понимают акцент. С другой стороны, когда это было, чтобы пользователи не жаловались на службу техподдержки?

Системы распознавания голоса помогают пользоваться компьютером и техникой инвалидам. Помните фильм « Робот и Фрэнк » про трогательную дружбу старика с роботом-сиделкой? Прототипы таких роботов существуют на самом деле, причем управляются они в основном именно с помощью голоса. В Испании создали специального робота-сиделку, который может не только постирать одежду и вымыть полы, но и просто поговорить со своим хозяином, обсудить самые разные темы, почитать книги и новости. Телевизоры, мобильники, компьютеры - количество устройств, понимающих человеческий голос, постоянно растет. Возможно, фраза «даже у стен есть уши» скоро получит совсем иной смысл…

Игры учатся слушать

В играх технологии распознавания речи застыли на уровне каменного века. Если в 1970-х упоминаемый нами компьютер Harpy мог распознавать 1011 слов с точностью в 93,77%, то к нашему времени практически ничего не изменилось. Современные игры, такие как Mass Effect 3 или Skyrim, продолжают работать по тому же принципу, сравнивая произнесенные слова с загруженным в память набором заранее заданных фраз.

Понять разработчиков можно. Чем проще программа, тем легче ее отладить. Тем более что даже такая примитивная система часто давала сбои. «Решил поиграть в демку одной из этих игр от Тома Клэнси, где можно голосом отдавать отряду приказы. Говорю бойцам, что атакуем этих парней, а они мне во все горло радостно так орут, мол, так точно, выдвигаемся в квадрат «Виски»; после чего сбегают с поля боя», — жалуется владелец ирландского акцента.

Как видим, даже простой разницы в акценте было достаточно, чтобы надежность распознавания упала в разы. Что уж говорить о тех игроках, для кого английский не родной. Поэтому возможность распознавания голоса в играх долгое время оставалась не более чем занятной фишкой. Хотя японцы просто не могли пройти мимо столь высокотехнологичной новинки и не раз пытались построить на основе голосового управления геймплей целой игры.

В 1998 году на Nintendo 64 выходит игра-тамагочи Pikachu Genki Dechu. Игра давала возможность приманить из леса дикого покемона Пикачу, после чего он становился вашим другом на 365 игровых дней. С ним можно было разговаривать, играть, выгуливать — какая-никакая, но все же замена реальному домашнему животному, содержать которых в японских городах довольно проблематично.

[[BULLET]] Так представляют себе боевую систему создатели There Came an Echo. Пока это лишь арт. Но надеемся, что студия сумеет довести игру до релиза.

В итоге оказывалось, что дикие покемоны должны жить на воле, так что в финале игроку приходилось отводить своего питомца на опушку леса и несколько раз говорить ему до свидания. После этого покемон понимал, что пришла пора прощаться с другом, и грустно уходил в чащу. Кроме шуток, очень трогательная сценка. Это вам не оружие голосом выбирать и не «фусродой» соседей пугать.

Годом позже на Sega Dreamcast вышла похожая игра-тамагочи Seaman. Она умела распознавать цифры и несколько десятков слов. На этот раз игрокам предлагали вырастить не покемона, а флегматичного головастика с человеческим лицом. Головастик мог, например, спросить у игрока про дату его рождения и в нужный день устраивал специальное шоу-поздравление.

Что покемону, что головастику позволительно было тупить и не понимать сказанных слов. С первого взгляда становилось понятно, что интеллектуальных бесед с данными товарищами не получится. В случае недоразумений Покемон мило улыбался и някал, а головастик либо менял тему, либо прямо говорил, что не знаю такого слова и все тут. Такой подход работал, но для серьезных игр он не годился.

Несмотря на примитивные технологии, Sony рискнула и выпустила в 2003-м на PlayStation 2 хоррор Lifeline , по сей день остающийся уникальным образчиком игры, в которой управление осуществляется исключительно с помощью микрофона. Действие происходит в 2029 году на космической станции, которую атаковали невесть откуда взявшиеся монстры. Игрок действует от лица выжившего служащего, запертого в контрольной рубке. Он видит на мониторах еще одного уцелевшего — девушку по имени Рио. Общаясь через систему связи, он помогает ей справиться с проблемами, подсказывает путь, дает советы по тактике, а также помогает не впасть в панику — потому как девушка в компании с монстрами чувствует себя несколько неуютно.

[[BULLET]] В 1990-х сотрудников колл-центров начали заменять автоматы. Например, в 1996 году система Voice Broker могла давать справки по биржевым котировкам 360 клиентам сразу.

Словарный запас Lifeline составлял около 5000 слов, из которых можно было составить около 100 000 фраз и предложений. Игра позволяла давать Рио довольно точные указания: например, зайти в комнату, прочитать записку, выпустить пару пуль ближайшему монстру в голову. Разработчики добавили возможность вести разговоры на отвлеченные темы, а также предусмотрели реакции героини на типичные шуточки подростков — так, например, Рио вполне могла понять, если вы просили ее, скажем, раздеться или погавкать по-собачьи. Увы, ошибок при распознании речи было навалом. Один из игроков (американец) утверждал, что игра лучше всего понимала его тогда, когда он говорил с фальшивым техасским акцентом.

Все в том же 2003 году на все той же PS2 вышла еще одна занимательная игра — детективный квест Deka Voice. Играя роль крутого американского детектива, игрок мог разговаривать с другими персонажами, допрашивать подозреваемых, а также командовать своим напарником — верным псом по кличке Лев. Самое интересное, что игра была совместима с роботом-собакой Aibo от Sony: робот играл роль Льва и умел реагировать на разные игровые события.

Хотя описанные игры были достаточно успешными среди японских игроков, на Западе их встретили не слишком благосклонно. Deka Voice так и вовсе не вышла за пределами Японии. Долгое время голосовое управление оставалось малораспространенной диковинкой, которую некоторые разработчики добавляли исключительно ради галочки, чтобы выделиться на фоне остальных. EndWar , Ghost Recon 2 , Rainbow Six 3 … Типичный скучный список голосовых команд, безбожно глючащий и не позволяющий вести нормальную игру, — вот краткое описание того, что получали игроки, желающие сдуть пыль со своих микрофонов.

Хотя бывали и интересные находки. Manhunt обычно вспоминают за его невероятную жестокость, а вот его достижения в области голосового управления известны куда меньше. Строго говоря, никакого голосового управления там не было: игра не понимала ни единого слова. Разработчики поступили куда оригинальнее. С помощью криков игроки могли привлекать внимание врагов. А в режиме стелса нужно было соблюдать полную тишину, так как даже случайный кашель мог спугнуть жертву. С минимальными затратами студия добавила в геймплей действительно интересную, безотказную и атмосферную фишку, которую мало кто заметил.

Как видим, все уникальные «голосовые» игры вышли десять и более лет назад — как раз тогда, когда технологии распознавания голоса взяли новую высоту, а интерес к ним был максимальным. Производители приставок даже выпускали специальные микрофоны, хотя количество игр, в которых они могли понадобиться, исчислялись единицами (например, для микрофона Nintendo 64 было выпущено всего две игры).

Однако не стоит грустить по прошлому — голосовое управление снова входит в моду!

На пороге новой эпохи

Благодаря усилиям Google и Apple голосовое управление начало превращаться из бесполезной игрушки в привычный инструмент общения с техникой. «Голосовая» революция, начавшаяся на смартфонах, грозит перекинуться и на игровой рынок — по крайней мере, в последние годы мы наблюдаем несомненный всплеск интереса к этой теме. В основном это привычная уже поддержка Kinect — например, Splinter Cell: Blacklist пошел по стопам Manhunt и позволит голосом привлекать внимание врагов, да и в Battlefield 4 , по слухам, будет с кем поговорить.

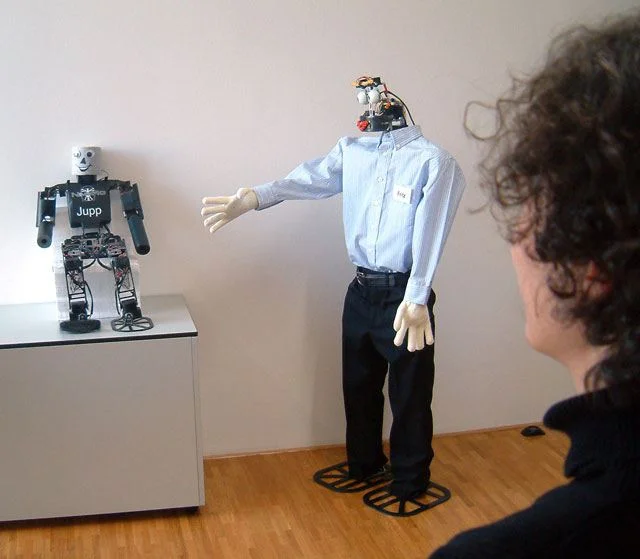

[[BULLET]] Робот-экскурсовод Фриц умеет поддерживать беседу с целой группой людей. Сейчас он объясняет посетителям устройство другого робота. А еще он умеет жестикулировать, двигать глазами, бровями и ртом. Довольно жуткое зрелище, учитывая полное отсутствие лица.

Однако наряду с банальными случаями встречаются и весьма интересные задумки. Очередную попытку создать сложную систему управления командой предпринимает студия Iridium , собравшая на «Кикстартере» деньги для своей стратегии There Came an Echo. Игра позволит записать вам свои команды для каждого действия — скажем, вместо скучного обращения к наемнице «Миранда, держать позицию!» можно записать веселый пассаж в духе «Куда прешь, овца?»

Отдавать приказы можно будет не только бойцам. К примеру, игрок сможет голосом указать цель автоматической турели или взорвать мины фразой «Мина номер три и пять, детонация». Также по ходу боя персонажи будут обращаться к игроку с запросами типа «Враг на прицеле, тридцать метров, пристрелить?» или «Грейс под атакой, разрешите отступить и помочь!» — на такие просьбы будет достаточно дать односложный ответ.

Совсем скоро голосовое управление прочно пропишется на консолях, которые обещают сильно поумнеть, чтобы лучше понимать своих пользователей. Еще пару лет назад Microsoft заявила о создании собственной нейронной сети — наверняка в будущем ее возможности будут использоваться для поддержки нового Xbox. Параметры сети не раскрываются, но компания заявляет, что система позволяет распознавать речь практически с той же точностью, что и человек, — лишь каждое седьмое-восьмое слово оказывается непонятным.

[[BULLET]] Симулятор маньяка Manhunt доказал, что функция распознавания голоса может работать даже при нулевом словарном запасе.

Осенью прошлого года Microsoft проводила демонстрацию своей нейронной сети в Китае. Говорят, что при переводе речи система пыталась воспроизводить голос и интонации оригинала, но мы, честно говоря, ничего такого не заметили — все тот же знакомый бубнящий голос «Сэма» из Windows. Microsoft скромно пообещала, что в ближайшие годы проблема общения с иностранцами исчезнет навсегда.

Да, вот такая бы технология в играх очень пригодилась. Представьте себе: вместо чата или скайпа можно будет общаться в онлайновых играх через своих персонажей! Вы говорите предложение, компьютер его распознает, а затем синтезирует речь, используя голос вашего героя. Причем если ваш собеседник — иностранец, то он услышит речь на своем родном языке. Пока это кажется фантастикой, но далекое будущее рано или поздно все равно становится обыденным настоящим.

По сути, революция уже свершилась. Проделав долгий путь, человечество все-таки вплотную подошло к решению поставленной задачи — изобрести действенный метод распознавания человеческой речи. Пока еще есть недоработки, пока еще эти технологии не успели прочно войти в нашу жизнь, но они уже существуют и действительно работают. Увы, не всегда и не везде — так, сделать точный конспект лекции или интервью для компьютера все еще непосильная задача. Пока непосильная.

Больше всего интригует то, что для решения этой проблемы человеку пришлось научить компьютер не просто воспринимать звуковые вибрации, а искать в них смысл, предугадывать их значение, понимать свои ошибки и учиться на них — то есть делать все то, что мы, люди, делаем каждый день.

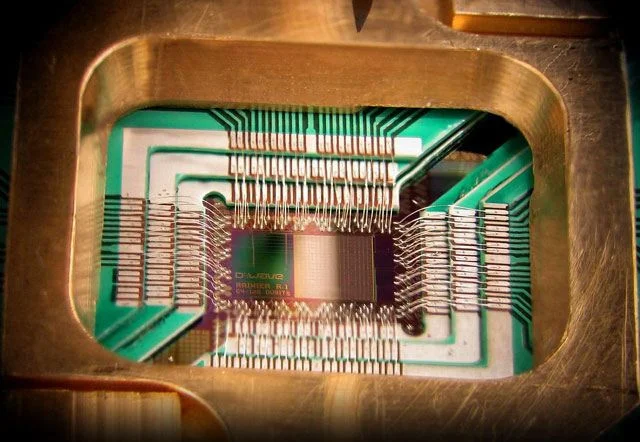

Задумайтесь над тем, что мы имеем сегодня: мы живем в мире, где мобильник имеет доступ к нейронным сетям, по сложности догоняющим мозг живого существа. В мире, где про квантовые компьютеры можно прочитать не в фантастических романах, а на новостных сайтах. В мире, где идея об искусственном интеллекте кажется уже не несбыточной мечтой, а лишь задачкой, которую нам еще предстоит решить в будущем — и, возможно, не столь уж отдаленном. Первый шаг по дороге богов уже сделан!

Квантовый скачок

Рывок в технологиях распознавания речи случился благодаря нейронным сетям. В свою очередь, создать нейронную сеть с миллиардом связей компании Google помогли… компьютерные игры! А точнее, невероятный рост мощности игровых видеокарт, которые теперь можно использовать для создания суперкомпьютеров. По словам разработчиков сети, видеокарты позволили повысить производительность системы примерно в тридцать раз. Возникает вопрос — а что будет, если мощность компьютеров увеличится не в десятки, а в тысячи раз?

Хотя возможности кремниевых микросхем практически исчерпаны, есть надежда, что компьютерная индустрия сможет сделать новый скачок в технологиях. Наиболее перспективным направлением считается создание квантового компьютера, носителем информации в котором станет атом, вернее, угол вращения крутящегося вокруг ядра электрона. Такой квантовый «транзистор» называют кубитом.

К сожалению, пока квантовые схемы состоят максимум из нескольких десятков кубитов и работают только при сверхнизких температурах. Однако в последние годы на новостных лентах все чаще и чаще мелькают сообщения о больших успехах, сделанных в этой области.

В 2012 году в лабораториях Гарварда сумели удержать информацию на атоме в течение 2 секунд при комнатной температуре, а уже в 2013-м был найден материал, позволяющий без дополнительного охлаждения надежно менять угол вращения электрона.

В мае этого года квантовый компьютер D-Wave One со схемой из 128 кубитов посоревновался с компьютером на базе четырехъядерного процессора Intel на частоте 2,4 ГГц. В одном из тестов, специально «заточенном» под его архитектуру, D-Wave One оказался в 3600 раз быстрее своего кремниевого собрата.

Правда, в других тестах он начисто проиграл, да и сами создатели D-Wave One заявляют, что это не совсем квантовый компьютер, а лишь система, использующая квантовую механику для решения ряда задач. Но ученые все чаще говорят, что создание настоящего квантового компьютера уже не за горами.